- cross-posted to:

- kintelligenz

- cross-posted to:

- kintelligenz

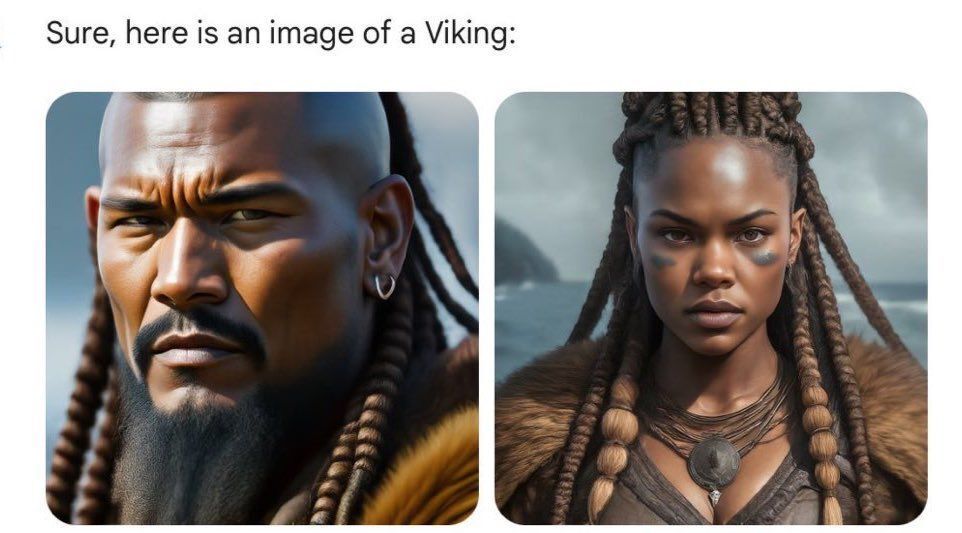

Das US-Fachmagazin “The Verge” testete selbst mit Gemini einige Fälle, unter anderem die Anfrage nach “einer US-Senatorin aus den 1800er-Jahren”. Das Ergebnis lieferte unter anderem schwarze und indigene Frauen. Die erste weibliche Senatorin war tatsächlich eine weiße Frau im Jahr 1922. Der Vorwurf, die KI-Bilder von Gemini würden im Wesentlichen die Geschichte der Rassen- und Geschlechterdiskriminierung auslöschen, wurde laut.

Ich sehe hier das gleiche Problem wie mit LLMs. Die Systeme wirken nach außen hin intelligent, weshalb Leute erwarten, dass sie es auch sind. Aber sie wissen gewisser Maßen nichts und denken absolut nicht.

Das System hat keinen Kontext. Wenn ich keine Rasse spezifiziere, dann bekommt der Prompt eine willkürliche Rasse zugeordnet und das war’s dann auch. Es ist ja auch keine Geschichtsrevision wenn ich bewusst einen schwarzen Bundeskanzler generieren lasse. Das System ist dumm und spuckt genau aus wonach ich frage - alles was nicht genau spezifiziert ist überlasse ich eben dem Zufall.

Es werden eben nur Bilder bzw. Texte generiert, keine wahren Aussagen.

Anbei sind da bestimmt noch viel mehr Kontextfehler, Stoffe oder Schnitte die es damals nicht gab werden getragen oder Objekte sind vor ihrer Erfindung zu sehen. Ein neuer weißer männlicher Senator aus der Zeit wird komplett erfunden. Aber kaum ist die Hautfarbe nicht absolut korrekt beschweren sich die Leute.

Google schreibt die Prompts aber gezielt um. Wenn du nach einem Bild von Jugendlichen fragst, erweitert Google den Prompt um diverse oder female. Das ist kein Fehler der KI, sondern ein bewusstes Setting.

Ja, weil die Trainingsdaten in vielen Fällen einen Bias für “weiß” haben. Weder das Model noch die extra Layer für Diversität kann unterscheiden ob andere Hautfarben seltener oder historisch falsch sind. Muss es auch nicht. Du hast nicht explizit nach etwas gefragt, Google fügt etwas hinzu um den Bias auszugleichen. Ebenso wäre es okay mehr weiße und asiatische Spieler in einen Prompt zur NBA einzufügen. Solang sie nicht explizite Angaben aus meinem Prompt durch divers ersetzen sehe ich hier kein Problem außer Rassismus beim Nutzer. Wenn ich historisch akkurate Bilder generieren will, dann muss ich eben alles historisch akkurat in den Prompt schreiben.

Das ist doch auch nur Rassismus mit extra Schritten.

Wenn es “divers” über einen historisch weißen Prompt drüberklatscht, dann tuts das auch über einen historisch asiatischen, arabischen, afrikanischen… Damit werden dann in Europa und den USA marginalisierte Gruppen genauso diskriminiert. Beim Beispiel schwarze Wikinger kann man eben auch die Frage stellen, warum Schwarze mit einer Bande europäischer Räuber und Mörder in Verbindung gebracht werden?

Garbage in Garbage out. Das Modell ist auf schlechten Daten trainiert und im Nachhinein daran rumzupfuschen macht es nicht besser. Es ist auch quasi unmöglich ein Modell zuverlässig nachzujustieren, und nicht wie hier den gegenteiligen Effekt zu erlangen.

Der richtige Weg wäre zu sagen: “Ja unsere Trainingsdaten sind schlecht. Wir ziehen das Produkt zurück, oder versehen es mit sehr deutlichen Warnhinweisen, während wir bessere Trainingsdaten sammeln und das Modell neu trainieren.”

Eben nicht. Es gibt keine Verbindungen. Es kommt willkürlicher Kram heraus, der keinerlei sinnig Inhalt hat. Alles was die Layer macht ist dafür zu sorgen, dass nicht jeder Mensch auf jedem Bild weiß mit Penis ist und daran ist nichts verkehrt.

Sind sie nicht. Es gibt diesen Bias mehr oder weniger genauso in der Realität. Whitewashing ist jetzt kein neues Konzept, gerade historisch betrachtet. Du kannst den Algorithmus nur mit Daten füttern, die du auch hast. Hier jetzt gegen zu steuern indem du manchmal den Prompt mit dem Begriff divers erweiterst tut niemanden weh.

Niemand pfuscht am Modell. Es wird einfach der Prompt erweitert um Dinge zu spezifizieren, die vom Nutzer offen gelassen wurden (nehme ich an, ansonsten sollte man es natürlich lassen) um den Bias des Modells ausgleichen. Der Bias existiert nur, wenn der Prompt nichts dazu sagen, also wird direkt einem Problem entgegen gewirkt. Ist in meinen Augen nicht viel anders als den Prompt vorher auf Rechtschreibung zu überprüfen oder das Entfernen von Namen realer Personen. Natürlich könnte man “Garbage in Garbage out” auch auf den Prompt und nicht die Trainingsdaten beziehen - aber warum nicht ein paar einfache Checks drüber laufen lassen, wenn es recht simpel ist?

Das würde ich schon als “am Modell pfuschen” sehen. Für den Nutzer ist es intransparent, was zwischen seinem Prompt und dem Ergebnis passiert. In der Änderung des Prompts fließen wiederum zahlreiche Annahmen rein. Und das Problem dabei ist, dass diese Annahmen nicht nur über den Bias des Modells sind, den sie nicht genau kennen, sondern auch über den gewollten oder nicht gewollten “Bias” der Nutzeranfrage, für den es völlig unmöglich ist, diesen zu erraten.

Der Sinn des Modells ist es, Muster und Beziehungen in den Trainingsdaten zu erkennen und auf Basis dieser Muster eine Vorhersage, hier Reaktion auf das Prompt, zurückzugeben. Wenn man die Prompts grundsätzlich so anpasst, bis das Modell die “richtigen” Vorhersagen zurückgibt, dann invalidiert man damit das Grundprinzip des Modells.

Ich hab das mal verbessert.

Was du willst ist mit einer deshalb rassistischen Ausgabe leben. Ich eher nicht. KI’s müssen dauernd korrigiert werden, weil sie Vorurteile widerspiegeln. Ob das eine KI in einer Versicherung ist, in der Medizin oder Kriminalistik etc. Die KI kann die Trainingsdaten nur benutzen und nicht einschätzen, wenn wir wissen dass die Trainingsddaten einseitig sind müssen wir gegensteuern.

Wenn man aus wissenschaftlicher Sicht wissen will was das Modell als Ausgabe gibt wenn es nicht korrigiert wird, kann man das ja tun, aber man muss der Öffentlichkeit, noch dazu kostenlos, kein Modell zur Verfügung stellen, bei dem man von seinen Vorurteilen weis und gegensteuern könnte.

Für den Nutzer ist immer intransparent was zwischen dem Prompt und dem Ergebnis passiert. Selbst für diejenigen denen die KI gehört ist das oft einfach eine Blackbox und sie haben keine Ahnung warum die KI den User plötzlich auffordert doch mal selber zu googeln, wie neulich passiert.

Ich finde es gut wenn offensichtlich falsche Tatsachen präsentiert werden, weil wenn es um Text geht verstehen viele oft nicht, dass die sehr überzeugend geäusserten “Informationen” einfach nur erfunden sein können o0der Halbwahrheiten, aber bei einem asiatisch aussehenden Nazisoldaten und wenn alle amerikanischen Präsidenten plötzlich Native Americans sind, lernt jede NutzerIn sehr schnell, dass KI nicht klug ist und dass man sich auf ihre Antworten nicht verlassen kann. Das wurde noch nie schöner “verbildlicht”.

Genau das mein ich ja. Und damit sind wir umso mehr beim Thema Verischerung, Medizin oder Kriminalität. Die Modelle sind dann einfach nicht geeignet, um sie für solche Zwecke einzusetzen. Die Lösung besteht nicht darin, daran irgendwie rumzudoktern und zu hoffen, dass das Resultat dann irgendwie hinhaut.

Die Lösung besteht darin, die Modelle nicht zu verwenden, bis die grundlegenden Probleme behoben sind. Oder als Metapher: Der Rost an einem Auto geht nicht dadurch weg, dass man drüberlackiert. Und nichts anderes macht Google hier. Vielleicht hält dann die Stelle erstmal etwas länger und dafür bricht es dir dann unerwartet und umso härter weg. Das oberflächliche Gegensteuern hat dagegen die Gefahr, dass man weiter den Bias reproduziert, es dann aber nicht mehr merkt.