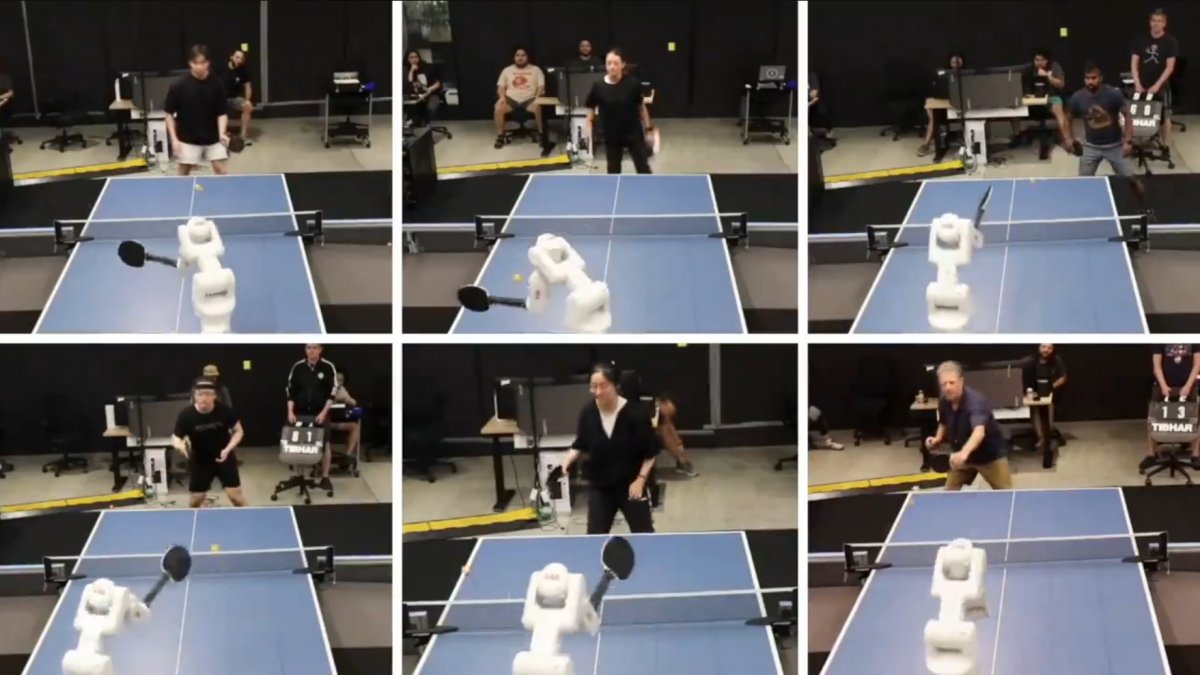

"Google Deepmind hat einen Roboter entwickelt, der beim Tischtennisspielen mit einem Anfänger mithalten können soll. Im Wettkampf erreichte der von Künstlicher Intelligenz (KI) gesteuerte Roboter die Leistung eines menschlichen Amateurs, erklärt Googles KI-Forschungseinheit. Menschen bräuchten jahrelanges Training, um im Tischtennis ein hohes Leistungsniveau zu erreichen.

Besondere Herausforderungen beim Tischtennis seien die Geschwindigkeit und die Hand-Auge-Koordination, so die Google-Forscher. Mit dem Roboter sei ein Schritt in die Richtung gelungen, dass Roboter bei physischen Aufgaben Geschwindigkeit und Leistung auf menschlichem Niveau erreichen. Der Roboter trat gegen 29 Spieler an, die Fähigkeiten zwischen Anfänger- und Turnierniveau mitbrachten. 13 der Matches gewann der Roboter. Die besten Spieler konnte er nicht besiegen. Dafür gewann er gegen alle Anfänger und mit 55 Prozent mehr als die Hälfte der Spiele gegen fortgeschrittene Spieler. Das zeige eine solide Leistung auf menschlichem Amateur-Niveau, erklärt das Forschungsteam in seinem Paper.

Hybrides Modell ermöglicht schnelle Koordination

Der Roboter ist demnach in der Lage, auch komplexe physische Aufgaben zu bewältigen. Tischtennis erfordert eine blitzschnelle Entscheidung und die Fähigkeit, sich dynamisch an das Spiel und den Gegner anzupassen. Der Roboter tut dies mittels einer Kombination aus Low-Level-Skill-Policies und einem High-Level-Strategie-Entscheider. Dank Ersteren ist der Roboter in der Lage, die spezifischen Tischtennis-Bewegungen wie Vor- oder Rückhandschläge und Aufschläge durchzuführen. Der zweite Teil analysiert das Spiel und passt sich an den Stil des Gegners an: Er entscheidet er darüber, welche der erstgenannten Techniken der Roboter in der jeweiligen Spielsituation einsetzt.

Eine Besonderheit sah das Forschungsteam vor allem im Training der Künstlichen Intelligenz. In einem hybriden Ansatz kombinierte es Verstärkungslernen (Reinforcement Learning) mit Nachahmungslernen (Imitation learning). Ersteres kommt für dynamische Steuerungsaufgaben zum Einsatz, etwa bei Fortbewegungen von Vierbeinern, und wird oft erst in der Simulation durchgeführt. Die Herausforderung ist, dass die Simulation nicht immer der Realität entspricht. Das soll die zweite Lernmethode aufheben: Das Nachahmungslernen orientiert sich an Beispielen, die die gewünschte Aufgabe gut lösen, was dann kopiert wird. Das schließt laut dem Paper des Forschungsteams die Lücke zwischen Simulation und Realität.

Verfolgung der Echtzeit-Spielstatistik

Der Roboter trat nach einem ersten Lernprozess mit wenigen Trainingsdaten aus menschlichen Spielen gegen einen menschlichen Gegner an. Mit jedem echten Match entstanden neue Daten, die wiederum in das Training einflossen. Der Roboter konnte seine eigene Leistung dadurch in mehreren Iterationen steigern. Allerdings war die KI vor allem in der Lage, sich an wechselnde Umweltbedingungen anzupassen – nicht aber an Menschen. Um Letzteres zu ermöglichen, verfolgten die Forscher in Echtzeit die Spielstatistiken, über die Stärken und Schwächen des Gegners und des Roboters deutlich wurden. Darüber konnte der Roboter sich mehreren wechselnden Gegnern besser anpassen.

Schwierigkeiten hat der Roboter bei ausgefeilteren Techniken. So sind besonders hoch oder schnell gespielte Bälle ein Problem. Das Forschungsteam vermutet die Ursache in der Latenz des Systems und fehlenden Daten. Auch das Rückhandspielen fällt dem Roboter eher schwer. Außerdem erkennt das System einen starken Spin des Balls nicht gut."

…und auch t3n @techreview_de@social.heise.de berichtet: “Wie Google DeepMind einen Roboterarm zum Amateur-Tischtennis-Spieler macht” 🤖🏓

Im Artikel auch noch ein paar Details, die an den anderen Stellen nicht so detailliert dargestellt wurden:

"Um ein guter Tischtennisspieler zu werden, braucht der Mensch eine hervorragende Hand-Augen-Koordination, die Fähigkeit, sich schnell zu bewegen und schnelle Entscheidungen zu treffen, um auf den Gegner zu reagieren – all das sind für Roboter große Herausforderungen. Um ihrer Maschine diese Fähigkeiten „beizubringen“ bzw. die Fähigkeit, diese nachzuahmen, haben die Forscher:innen von Google DeepMind einen zweiteiligen Ansatz verwendet: Sie nutzten Computersimulationen, um das System zu trainieren, damit es seine Schlagfertigkeit beherrscht, und nahmen dann eine Feinabstimmung anhand von Daten aus der realen Welt vor, wodurch es sich mit der Zeit verbessern konnte.

Die Forscher:innen stellten einen Datensatz von Tischtennisballzuständen zusammen, einschließlich Daten zu Position, Spin und Geschwindigkeit. Das System griff auf diese Bibliothek in einer simulierten Umgebung zurück, in der die Physik von Tischtennisspielen genau widergespiegelt wurde, um Fähigkeiten wie das Zurückspielen eines Aufschlags, das Schlagen eines Vorhand-Topspins oder eines Rückhandschlags zu lernen. Allerdings mit einer Einschränkung: Da der Roboter aufgrund seiner „Physis“ den Ball nicht selbst aufschlagen konnte, wurden die realen Spiele entsprechend angepasst.

Kontinuierliche Feedbackschleife

Während seiner Spiele gegen Menschen sammelt der Roboter Daten über seine Leistung, um sein Spiel zu verbessern. Den Ball behält er mit Hilfe von Daten, die von zwei Kameras erfasst werden, im Blick. Den Spielstil seines menschlichen Gegners erfasst ein Motion-Capture-System, das LEDs am Schläger des Gegners verwendet. Die Balldaten werden für das Training in die Simulation zurückgespeist, wodurch eine kontinuierliche Feedbackschleife entsteht. (…) Probleme, den Ball zu treffen, hatte der Roboterarm vor allem, wenn dieser zu schnell, außerhalb seines Sichtfeldes (höher als 1,80 Meter über dem Tisch) war oder er sehr niedrig auf den Roboter zukam, denn in seinem Protokoll war er angewiesen, Schläge zu vermeiden, die den Tischtennisschläger beschädigen könnten. Auch mit rotierenden Bällen hatte die Maschine seine Schwierigkeiten: Der Roboter konnten den Spin nicht direkt messen – das fanden auch die fortgeschrittenen Gegner schnell heraus und nutzten dies als Vorteil für sich.

(…) „Gern als Trainingspartner“

Entscheidend ist, dass die menschlichen Spieler Spaß an ihren Spielen gegen den Roboterarm hatten. Sogar die fortgeschrittenen Teilnehmer, die ihn besiegen konnten, sagten, dass sie Spaß hatten und dass sie das Gefühl hatten, dass der Roboterarm ihnen als dynamischer Übungspartner helfen könnte, ihre Fähigkeiten zu verbessern.

„Ich würde ihn auf jeden Fall gerne als Trainingspartner haben, jemanden, mit dem ich von Zeit zu Zeit ein paar Matches spielen kann“, sagte einer der Studienteilnehmer:innen."

/ @Treczoks@lemmy.world